|

|

(更新ing)

1 Target-Aspect-Sentiment Joint Detection for Aspect-Based Sentiment Analysis(面向面向情感分析的目标-方面-情感联合检测)(AAAI 2020 )

基于方面的情感分析(ABSA)旨在检测文本中的目标(由连续词组成)、方面和情感极性。

ABSA形式化为一个从句子中进行目标-方面-情感检测的任务,其中

- 目标由句子中连续的单词组成(可以为NULL)

- 方面从预定义的词汇中提取

- 情感是目标和方面的极性(积极、消极或中性)。

基于前人研究提出的问题:

情绪实际上取决于目标和方面,而大多数关于ABSA的现有研究没有处理这种双重依赖。另一方面前人研究很多都没有解决好目标为隐性(NULL)的情况下的分析。

contribution 1(/3)我们提出了一种解决方案,以捕捉情感对目标和方面的双重依赖,并处理隐性目标案例。 提出:

上述挑战要求解决目标-方面-情感检测(TASD)任务,即从一个句子中检测目标-方面-情感三元组。为此,我们开发了一种新的基于神经网络的目标-方面-情感联合检测方法。

方法概述:

该方法以方面-情感对为基础,将联合检测问题分解为两个子问题,其中对于每个给定的方面-情感对,一个子问题确定目标是否存在(可约化为一个文本二分类问题),另一个子问题提取所有目标并可约化为一个序列标注问题。

这两个子问题都由一个基于预训练语言模型BERT的单一神经模型解决(Devlin et al. 2019)。通过最小化两个子问题的组合损失函数来训练神经模型

contribution 2(/3)我们提出了一种基于BERT语言模型的神经模型,该模型可用于目标方面-情感的共同预测。

contribution 3(/3)SOTA

2 Relational Graph Attention Network for Aspect-based Sentiment Analysis(基于方面情感分析的关系图注意网络)(2020ACL)

它的目的是确定一个句子中出现的一个或多个方面的情感两极。(没有提到目标哦)

基于前人研究提出的问题:

将各个方面与各自的观点词汇联系起来是这项任务的核心。近期的方法大都是借助各种各样的注意力机制去实现上述任务,虽然能取得一定的成果但是由于语言形态和句法的复杂性,这些机制有时会失效。

比如对于句子“So delicious was the noodles but terrible vegetables”来说如果不考虑其语法结构可能会由于对于noodles来说terrible更近导致判断为noodles-terrible 因此后来考虑进语法的因素。人为制定的语法规则会使模型受到规则的数量和质量的影响。然后使用基于依赖关系的解析树来提供更全面的语法信息。为此,可以用递归神经网络(RNN)对从叶到根的整个依赖树进行编码,或内部节点距离可以计算并用于注意权值衰减(He等人,2018a)。

最近,图神经网络(GNNs)被用来学习依赖树的表示,该类方法有如下缺点:

- 首先,表明方面和意见词之间的依赖关系会被忽略

- 从经验上来说,解析树中只有很小一部分是与任务相关的,没有必要对整棵树编码

- 最后,编码过程依赖于树,使得优化过程中的批处理操作不方便。

提出:

在本文中,我们重新审视了句法信息,并提出揭示与任务相关的句法结构是解决上述问题的关键。

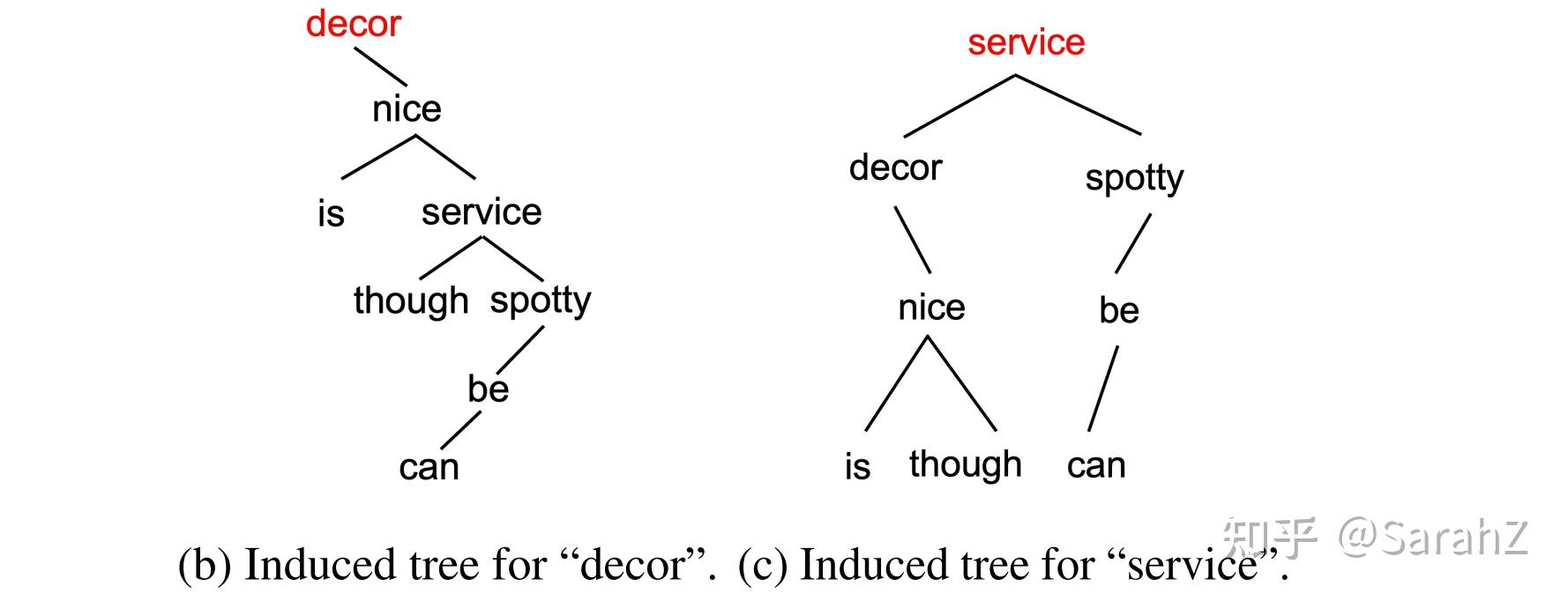

方法概述:

- 首先,我们使用普通解析器得到句子的依赖树

- 其次,我们重塑依赖树,使其扎根于有问题的目标方面

- 最后,对树进行修剪,只保留与方面有直接依赖关系的边

这种统一的树形结构不仅可以让我们关注方面和潜在意见词之间的联系,而且可以方便批量操作和并行操作。

contribution 1(/3)我们提出了一个面向方面的树结构,通过重塑和修剪普通的依赖树来关注目标方面。

- 然后我们提出一个关系图注意网络(relational graph attention network,R-GAT)模型来编码新的依赖树,R-GAT推广了图注意网络(GAT),对带标记边的图进行编码。

contribution 2 (/3) 我们提出了一个新的GAT模型来编码依赖关系,建立方面和意见词之间的联系。

contribution 3 (/3) 为了将来的研究,本文发布了该工作的源代码。 3 Improving Aspect-based Sentiment Analysis with Gated Graph Convolutional Networks and Syntax-based Regulation (用门控图卷积网络和基于句法的规则改进面向方面的情感分析)(2020EMNLP)

基于方面的情感分析(ABSA)是情感分析(SA)的一个细粒度版本,旨在找出输入句子对给定方面的情感极性

前人研究

深度学习用于基于方面的情感分析已经取得很大成就,语义依赖树的结合进一步提升了性能(叫做基于图的深度学习模型)。其中,依赖树有助于将方面术语与句子中句法相关的单词直接联系起来,进而有助于图卷积神经网络(Kipf and Welling, 2017)enrich方面术语的表示向量。

问题提出1

然而,在这些基于图的模型中,至少有两个主要问题需要解决,以提高性能。

- 首先,当前基于图的ABSA模型中不同层中的词的隐含层向量没有针对方面术语进行定制,这可能会导致次优的表示向量,其中与ABSA无关的信息可能会被保留,并影响模型的性能。因此,本文提出使用方面术语的信息来调节基于图的ABSA模型的隐藏向量,从而过滤术语的无关信息,并自定义ABSA的表示向量。

解决方法1

利用方面术语的表示向量,为基于图的ABSA模型的每一层计算一个门向量。然后,将各层的门向量应用于当前层的隐藏向量,以产生为ABSA定制的隐藏向量。

另外,提出了一种新的机制来显式增加gates间的上下文特征(区分),以进一步改善表示向量。

contribution 1(/3)针对ABSA,提出一种基于图卷积神经网络的词表示向量调节方法 问题提出2

当前基于图的深度学习模型的第二个限制是未能明确利用句子中单词的整体重要性,这些单词重要性可以从ABSA问题的依存树中估计。具体来说,我们可以为句子中的每个单词指定一个分数,这个分数是用来量化此单词在句子中对于方面词情感分类的重要性。

解决方法2

本文假设来自依赖树的这些全局的重要性分数也可以提供有用的知识,能够用来改善ABSA基于图的模型的表示向量。因此,本文提出通过与基于模型的重要性分数的一致性,将这些基于语法的重要性分数中的知识注入到基于图的ABSA模型中。

具体来说,在使用基于图的模型计算表示向量时,我们为句子中的每个单词计算第二个分数,以反映模型角度下单词对方面术语情感重要性。然后,利用基于句法的重要性得分(上述得分)来监督基于模型的重要性得分,作为一种将句法信息引入模型的方法。

为了计算基于模型的重要性分数,我们利用了这样的直觉: 如果一个单词与整体表示向量在模型的最后一步中的表示更相似,那么它对ABSA来说就更重要。(PS:感觉这个模型的重要性分数就是上面那个基于句法的重要性得分,或者说是同一个目标,未考证)

contribution 2(/3) 提出了一种新颖的方法以促进基于给定方面词的基于语法和基于模型的单词重要性得分之间的一致性。

contribution 3(/3)在ABSA的三个基准数据集上进行了广泛的实验,在所有数据集上取得了新的SOTA 4 Dynamic and Multi-Channel Graph Convolutional Networks for Aspect-Based Sentiment Analysis(面向方面情感分析的动态多通道图卷积网络)(2021.findings-acl)

方面级情感分析旨在判断评论中给定方面词的极性。

前人研究发展

注意力方法的局限性:受限于共现频率或长程词体面度,注意力机制可能会对不相关词赋予错误的值。

'the stuff should be more friendly',由于stuff和friendly共现频率很高,注意力机制可能会将“友好”视为对“人员”的评价词,从而产生完全相反的情感判断。 为了解决这些限制,一些研究将句法结构编码为建立方面之间联系的关键信息。以及他们的观点。一个手工设计的语法规则(Liu等人,2013)已经作为一篇早期文章编码到模型中。然而,它过度依赖于规则的质量。然后,依存树被视为句法规则的另一种形式(Dong et al., 2014;Nguyen和Shirai, 2015;Wang等人,2016a)通过递归神经网络(RNN)编码依存树。最近,图神经网络的快速发展引起了人们的兴趣,由于具有强大的学习结构表示的能力,设计了一类图神经网络来从依存树中提取句法信息

<hr/>简述:目前的方法大多采用基于句法的图神经网络从依存图中抽取句法信息,认为句法信息有助于建立方面词和情感词之间的关系。

问题提出

尽管与基于注意力的模型相比,这些方法有不少改进,但其缺点也不容忽视。

他们可能会忽略一些没有显著句法结构的句子,从而导致情感分析中出现相反的判断。举个例子,“Charlie sheen your fucking annoying”,twitter数据集中的一个句子,更喜欢口语表达,没有明确的语法结构,这使得那些提取的结构信息成为噪声。

此外,依存树上的信息并非都对我们的任务有效,基于gnns的模型会对噪声进行编码,如果在此基础上使用注意力机制,则会造成二次噪声(Zhang et al., 2019a)。

更糟糕的是,GCN已被证明未能在具有丰富信息的依存图中优化地整合节点特征(语义信息)和拓扑结构(语法结构)(Wang et al., 2020b),这表明GCN可能需要费力地学习拓扑结构(语法结构)和节点特征(语义信息)之间的一些深层关联。

提出

该文通过对句法信息、语义信息及其组合进行优化融合来解决这一问题。

方法概述

首先,利用依存树和多头自注意力分别生成句法图和语义图

然后提出一种动态多通道图卷积网络(Dynamic and Multi-channel Graph Convolutional Network, DM-GCN)来有效地从生成的图中学习相关信息

具体:

实际上,语法与语义是互补的。在这一基本假设的激励下,我们的动态多通道图卷积网络(DM-GCN)旨在克服上述弱点。

- 首先,为了充分利用语义空间中的信息,在图卷积网络中通过多头自注意力机制动态地生成和更新语义图

contribution 1(/3)我们提出了一种由多头自注意力机制生成和更新的动态语义图,其重点是提取语义空间中最相关的信息。

- 其次,将句子的依存树转化为句法图,这与上述模型相同(Sun et al., 2019;Zhang et al., 2019a)。

- 利用语义图和句法图,使用两个特定图卷积网络分别从语义和句法空间中提取两种特定信息。

- 进一步,考虑到语义和句法空间的公共信息与具体信息同等重要,设计了参数共享图卷积模块来提取公共信息。

- 最后,利用可训练的参数矩阵自适应地学习不同嵌入的重要性,并对其进行优化融合。

contribution 2(/3)我们提出了一种新的动态多通道GCN(Dynamic and Multichannel GCN, DM-GCN),可以根据句子的特点进行自适应学习和融合。

contribution 3 (/3)大量的实验结果证明了正确利用句法、语义及其组合信息的重要性,并证明了该模型在情感分类中提取和融合它们的有效性。 5 Dual Graph Convolutional Networks for Aspect-based Sentiment Analysis(面向面向方面情感分析的对偶图卷积网络)(2021ACL)

解决ABSA任务的关键是对方面与其对应观点表达之间的依赖关系进行建模。

前人研究:

- 带有注意力机制的RNNs;但是一种固有的缺陷使得注意力机制容易受到句子噪声的影响。

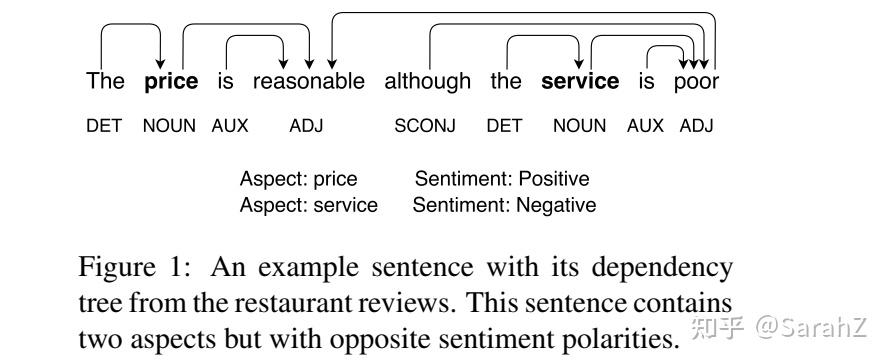

对于方面词“服务”来说,评价词“reasonable”比“poor”会得到更多的关注,然而事实上“reasonable”对应的词是“price”

- 最新的方法是基于依赖树的图卷积网络(GCNs)和图注意力网络(GATs),它们显式地利用了句子的句法结构。

考虑图1中的依赖关系树,句法依存关系可以建立句子中词语之间的联系。例如,属性&#34; price &#34;与评价词&#34; reasonable &#34;之间存在依存关系。 改进点

然而,将句法依存知识应用于ABSA任务时存在两个挑战,由于1 依存句法分析结果的不准确性以及2 在线评论表达的不规范性和复杂性,这种改进是有限的。

提出

为了克服这些挑战,本文提出了一种同时考虑语法结构互补性和语义相关性的双图卷积网络(DualGCN)模型。

方法概述

对于第一个挑战(1 依存句法分析结果的不准确性)

- 我们使用依存句法分析器得到的所有依存弧的概率矩阵来构建一个基于句法的图卷积网络(SynGCN)。这种方法背后的思想是,与依存句法分析器的最终离散输出相比,表示单词之间依存关系的概率矩阵包含了丰富的句法信息。

- 其次,利用自注意力机制构建了一个基于语义相关性的图卷积网络(SemGCN)。这种方法背后的想法是,由自关注形成的注意力矩阵,也被视为一个边加权有向图,可以表示单词之间的语义相关性。

- 此外,受DGEDT (Tang等人,2020)工作的启发,利用联射模块在SynGCN和SemGCN模块之间建立相关信息的桥梁

contribution 1(/3) 本文针对ABSA任务提出了一种DualGCN模型。DualGCN同时考虑了句子的句法结构和语义关联。DualGCN通过一个互仿射模块集成了SynGCN和SemGCN网络。

摘要部分:为了减少依存分析错误,设计了一个包含丰富句法知识的SynGCN模块。为了捕获语义相关性,设计了一个具有自注意力机制的SemGCN模块。(PS:语法用依赖树,语义用注意力机制) 此外,设计了两个正则化器来增强DualGCN模型。

- 我们注意到每个单词的语义相关术语不应该重叠。因此,我们鼓励单词的注意力概率分布是正交的。为此,在SemGCN模块的注意力概率矩阵上加入了一个正交正则化器。

- 此外,从SynGCN和SemGCN模块学习到的两种表示在句法依赖和语义相关性上都包含明显不同的信息。因此,我们期望SemGCN模块可以学习不同于句法表示的语义表示。本文提出SynGCN和SemGCN模块之间的差分正则项。

contribution 2(/3)本文提出正交正则化和微分正则化。正交正则项鼓励SemGCN网络学习正交语义注意力矩阵,而差分正则项鼓励SemGCN网络学习不同于SynGCN网络的语法特征的语义特征。

摘要部分:此外,本文提出正交和差分正则化器,通过约束SemGCN模块中的注意力分数来精确捕捉单词之间的语义相关性。正交正则项鼓励SemGCN学习每个单词重叠较少的语义相关单词。差分正则化器鼓励SemGCN学习SynGCN无法捕获的语义特征。

contribution 3(/3)在SemEval 2014和Twitter数据集上进行了广泛的实验。实验结果验证了DualGCN模型的有效性。此外,GitHub1上提供了我们工作中使用的源代码和预处理数据集。 6 Beta Distribution Guided Aspect-aware Graph for Aspect Category Sentiment Analysis with Affective Knowledge(基于Beta分布引导的方面感知图的情感知识方面类别情感分析)(2021 EMNLP)

任务区分:

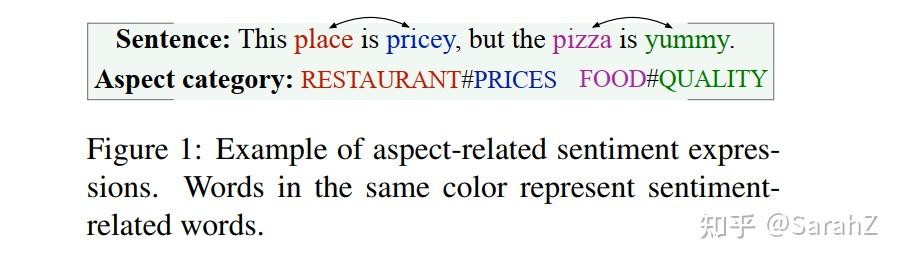

方面类别情感分析(Aspect category sentiment analysis, ACSA)旨在从给定的句子中检测出一个粗粒度方面类别的情感极性。与目标依赖或方面词情感分析任务中目标或术语明确地出现在句子中不同,ACSA中的方面类别并不一定出现在句子中。在这里,方面类别(以下也称为方面)通常由实体E和属性A(即e# A)或仅由实体E组成。

提出概念

摘要:该文从一个新颖的视角研究方面类别情感分析任务,探索一种基于外部知识的Beta分布引导的方面感知图构建方法。也就是说,我们不再纠结于如何从上下文中费力地搜索粗粒度方面的情感线索,而是如何在上下文中更好地找到与方面情感高度相关的词并基于公共知识库确定其重要性,从而自然地学习这些词在ACSA中的方面相关上下文情感依赖。 为什么提出新的方法?

A: 纯粹基于隐式方面从上下文中理解面向方面的情感词是一项艰巨的任务。这主要是因为

- 方面类别通常在上下文中不明显

- 在同一上下文中可能会提到多个方面和情感极性

相反,我们可以利用句子中明确出现的方面相关单词来建模方面的上下文情感信息。

方法

具体地,我们将不同的方面作为不同的枢轴,然后从外部知识中搜索与方面相关的词,称为方面感知词,这些词代替粗粒度的方面来构建特定方面的上下文图。即部署外部知识作为隐性方面类别与上下文之间的桥梁,通过图的构建方式巧妙地、主动地在高度相关方面的语境词与具体方面之间建立联系。 根据知识库,一个词可以通过各种途径与某个方面连接或不连接,成功连接的概率(对应于图中边的权重)可以自然地看作是一个二项分布。因此,本文通过对基于外部知识的先验知识(路线和连接信息)的所有成功连接可能性的建模来研究边的权重,该先验分布是二项分布的共轭先验分布(Gupta和Nadarajah, 2004)。通过这种方法,可以考察所有方面感知词与某方面相关的概率,从而确定该方面感知词的最佳置信度(权重),称为方面感知权重。

随后,对于给定aspect,基于所有方面感知词以及其权重构成的对,去构建context的方面感知图。

contribution 1(/3)ACSA任务从一个新颖的视角进行研究,即学习如何发现与属性高度相关的属性词并推断其对属性的重要性,从而用这些词构建一个图来学习ACSA中的上下文情感特征。(PS:替代)

contribution 2(/3)提出了一种新颖的场景,利用Beta分布对方面感知词的所有重要概率进行建模,从而导出方面感知权重,从而构建知识增强的方面感知图。 在此基础上,提出一种方面感知的图卷积网络(AAGCN)结构,用于获取上下文对方面的情感依赖,从而实现ACSA。

contribution 3(/3)提出了一种方面感知的图卷积网络,用于提取方面的上下文情感依赖进行情感检测,并取得了最先进的性能 7 Discrete Opinion Tree Induction for Aspect-based Sentiment Analysis(面向方面情感分析的离散观点树归纳)(2022ACL)

如何为每个方面词定位相应的观点上下文是ABSA面临的一个关键挑战。

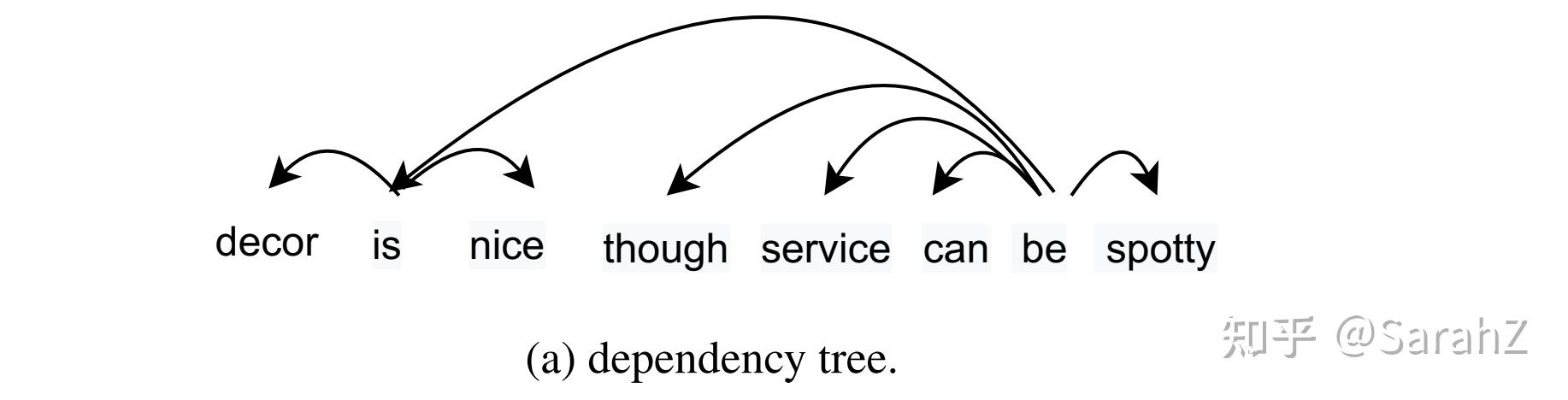

下方是一般的依赖树的样子

基于现有研究突出的问题

依存树已经大量与图神经网络一起用于基于方面的情感分类。

虽然这种方法很有效,但依赖于外部依赖解析器,这些解析器对于低资源语言可能不可用,或者在低资源领域的性能更差。

此外,依存树也没有针对方面级情感分类进行优化。(之前的研究通过手工制定规则将依赖树转换为特定方面的形式,以提高属性情感分类性能。然而,ABSA主要根据节点的层次结构进行树结构的调整,没有对依赖关系进行优化。)

提出

本文提出了一种特定于方面且与语言无关的离散潜在观点树模型,作为显式依存树的替代结构。 效果如下

方法

为了简化复杂结构潜变量的学习,在方面到上下文注意力分数和句法距离之间建立了联系,从注意力分数中诱导树。

具体来说,给定一个目标和一个句子,我们的算法根据一组注意力分数递归地归纳出一个树结构,该分数是使用一个神经层去处理句子在BERT的表示之上的。该算法从根节点开始,通过在当前节点的每一边选择一个子节点来构建树,递归地继续划分过程,得到一个二值化、词法化的树结构。

得到的树作为输入结构,输入到图卷积网络中学习情感分类器。

本文研究基于策略的强化学习来训练树诱导器。一个挑战是,生成的策略很容易被BERT编码器记住,这导致探索不足(Shi等人,2019)。为缓解这个问题,本文提出一组正则化器来帮助基于bert的策略生成。

8 Modelling Context and Syntactical Features for Aspect-based Sentiment Analysis(面向方面情感分析的上下文和句法特征建模)(2021ACL)

基于前人研究提出的问题

文章建立了一个端到端的ABSA解决方案,而不是单独考虑任务。

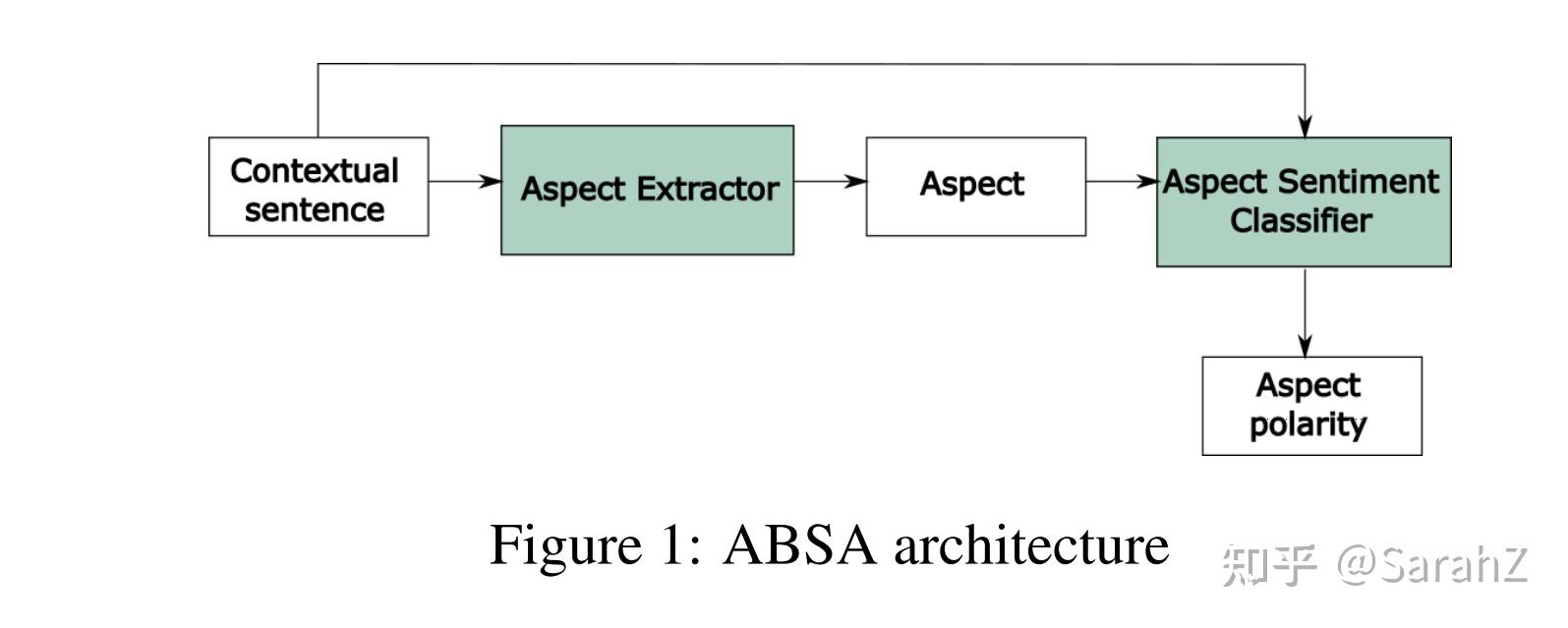

基于方面的情感分析(ABSA)由两个子任务组成,即方面提取(AE)和方面情感分类 (ASC)。然而,大多数报告的工作只关注两个子任务中的一个。与独立训练的单任务模型相比,多任务模型的性能往往较差。

在调查了用于方面提取的最新BERT/ robertaba架构后,很明显他们无法确定多词方面的边界。例如,提取器将多词表达“食品质量”分解为“质量”和“食物”。本文假设这一缺点是由于上下文嵌入无法编码丰富的句法信息造成的。

提出了

本文提出了将语法信息融入上下文嵌入中,提出了一种包含方面提取器和方面情感分类器的ABSA解决方案

构成

如图所示

AE架构名为基于上下文语法的方面提取(CSAE),由POS嵌入、基于依存关系的嵌入(Levy和Goldberg, 2014)和自注意力(selfattention)以及RoBERTa层组成。

该文从句子的语法角度出发,利用自注意力机制进行句法学习。

结合了词性嵌入、基于依存关系的嵌入和上下文化嵌入(如BERT、RoBERTa),以增强方面提取器的性能。

contribution 1(/3)提出了多通道CSAE模型,将语法特征提炼为上下文特征,以改进顺序标注 我们的ASC解决方案与Zeng等人(2019)的工作密切相关,其中利用局部上下文焦点(LCF)机制来降低远离局部上下文的单词的贡献。然而,该方法简单地将两个词语之间的词语计数视为语义相对距离,忽略了词语之间的相互句法关系。我们提出的方法以依存句法分析树中两个词之间的最短路径作为句法相对距离syntactic relative distance (SRD)。

此外,该文还提出了句法相对距离的概念,以弱化与体术语句法联系较弱的不相关词的负面影响。

contribution 2(/3) 提出了LCFS-ASC,可以分析单词之间的句法联系,以更好地理解与目标方面术语相关的局部上下文

contribution 3(/3) 通过探索LCF层中的注意力分数来研究SRD的重要性。 9 A Unified Generative Framework for Aspect-based Sentiment Analysis(面向方面的情感分析统一生成框架)(2020ACL)

基于现有研究提出的问题

ABSA中存在7个子任务。 虽然任务间有很强的相关性,但是大多数研究只关注这些子任务的子集,导致ABSA模型各种复杂,难以在统一的框架中求解这些子任务。

7个子任务:

- 方面术语提取(AE): 从句子中提取所有方面术语。

- 观点术语抽取(OE): 从一个句子中抽取所有的观点术语。

- 方面级情感分类(ALSC): 预测句子中每个给定方面术语的情感极性。

- 面向方面的观点抽取(AOE): 抽取句子中每个给定方面术语的成对观点术语。

- 方面术语提取和情感分类(AESC):同时提取方面术语以及相应的情感极性。

- 成对抽取(Pair):同时抽取方面术语和相应的观点术语。

- 三元组提取(Triplet):同时提取所有方面术语及其对应的观点术语和情感极性

以下分歧使得在统一框架中解决所有子任务变得困难。

- 输入: 部分子任务(AE、OE、AESC、Pair和Triplet)只将文本句子作为输入,其余子任务(ALSC和AOE)将文本和给定的方面术语作为输入。

- 输出: 有些任务(AE、OE、ALSC、AOE)只从a、s或o输出某一类型,其余任务(AESC、Pair和Triplet)返回a、s和o的复合输出。

- 任务类型: 有两类任务:抽取任务(提取方面和观点)和分类任务(预测情感)。

提出

abstract 我们基于统一公式,利用预训练序列到序列模型BART在端到端框架中求解所有ABSA子任务。

文中将每个子任务目标重新定义为一个由指针索引和情感类别索引混合的序列,将所有ABSA子任务转换为一个统一的生成式公式。 在上述观察的激励下,本文提出一个统一的生成框架来解决所有ABSA子任务。

contribution 1(/4)将ABSA的抽取任务和分类任务表述为一个统一的索引生成问题。与以前的统一模型不同,该方法不需要为不同的输出类型设计特定的解码器。 方法:

首先将所有这些子任务表述为一个生成任务,可以处理输入、输出和任务类型方面的障碍,并在不改变任何模型结构的情况下适应所有子任务。

具体地,将提取和分类任务分别建模为指针索引和类索引生成。基于统一的任务公式,使用序列到序列的预训练模型BART (Lewis等人,2020)作为骨干,在端到端过程中生成目标序列。

contribution 2(/4) 通过重构,所有ABSA子任务都可以在序列到序列框架中解决,该框架易于实现,可以在预训练模型上构建,如BART。

contribution 3(/4)据我们所知,这是第一个在所有ABSA任务上评估模型的工作。

contribution 4(/4)实验结果表明,所提出的框架明显优于最近的SOTA方法。 10 Relation-Aware Collaborative Learning for Unified Aspect-Based Sentiment Analysis(面向统一方面级情感分析的关系感知协作学习)(2020ACL)

基于前人研究提出来的问题

方面级情感分析(aspect- based sentiment analysis, ABSA)包含3个子任务,即方面术语抽取、观点术语抽取和方面级情感分类。大多数现有的研究只关注这些子任务中的一个。最近的一些研究在统一的框架下成功地解决了完整的ABSA问题。然而,3个子任务之间的交互关系仍未得到充分挖掘。这种关系编码了不同子任务之间的协作信号。例如,当评价词是“美味的”时,外观词必须是“食物”而不是“地方”。

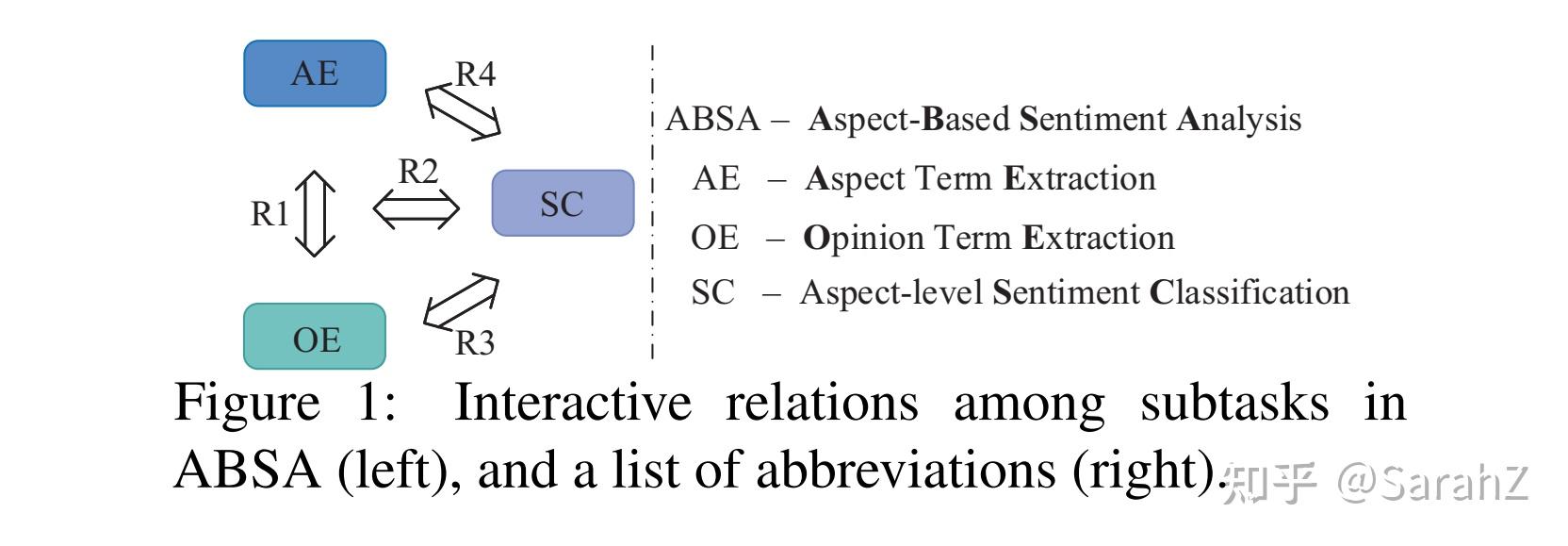

图1总结了详细的关系,其中每个箭头表示一个特定的关系Ri。

- R_{1} 表示AE和OE的二元关系。在实践中,方面词必须是意见的对象,这说明大多数方面词如“地方”只能由相应的意见词如“小”、“局域”来修饰,而不能用“美味”来修饰。

- R_{2} 表示SC和 R_{1} 之间的三元关系。SC中的一个关键问题是确定方面与其上下文之间的依赖关系。例如,语境 &#34; small and cramped&#34;对预测&#34; place &#34;极性有重要作用。这种依赖关系与强调属性词和观点词相互作用的 R_{1} 高度一致。因此,SC和 R_{1} 可以帮助完善彼此的选择过程。

- R_{3} 表示SC与OE的二元关系。特定的意见术语通常传达特定的极性。例如,fantastic通常是褒义的。OE中抽取的观点术语在SC情感极性预测中需要得到更多的关注。

- R_{4} 表示SC与AE之间的二元关系。在完整的ABSA任务中,方面术语是未知的,SC将为每个单词分配极性。方面词如“地点”、“食物”会有相应的极性,而其他词则被认为是没有情感的背景词。也就是说,AE的结果应该有助于指导SC的培训。

提出

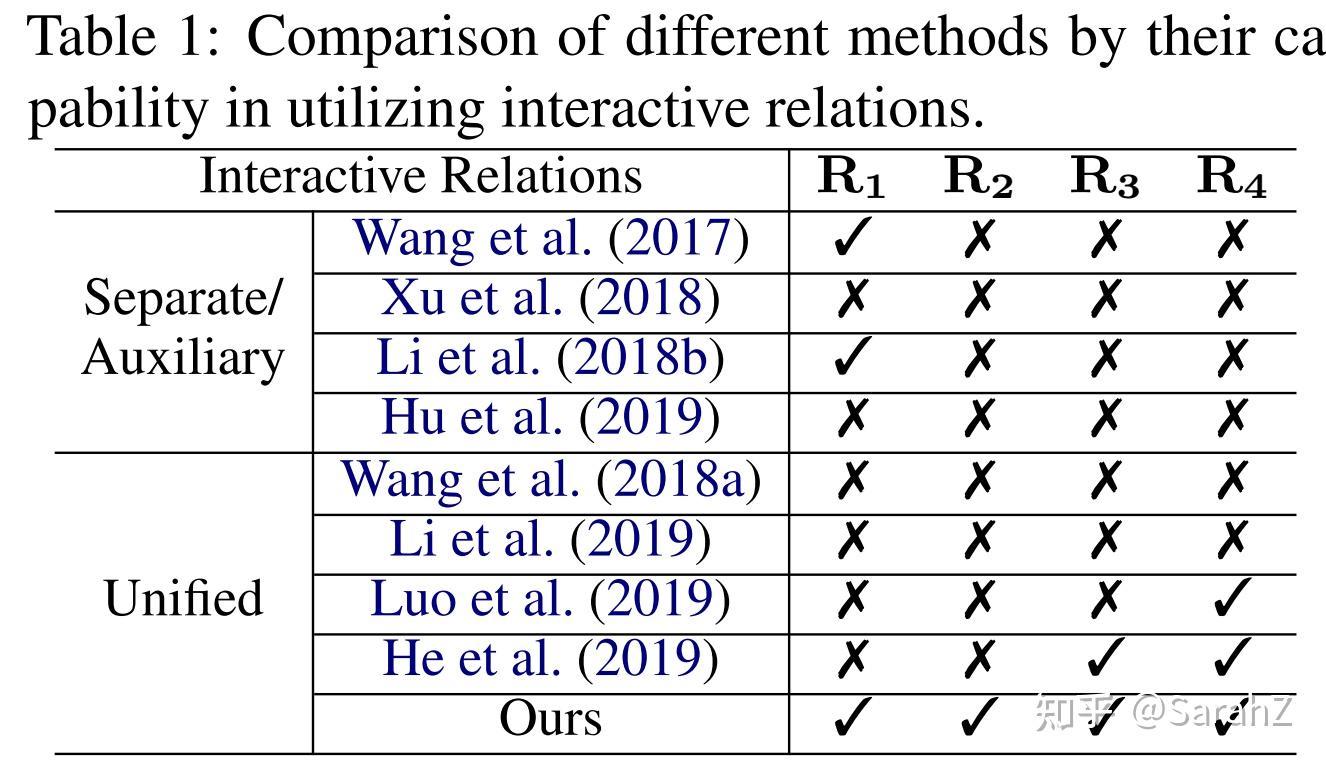

为了充分利用这些关系,本文提出了一种关系感知的协作学习(RACL)框架,允许子任务通过多任务学习和关系传播机制在堆叠的多层网络中协同工作。 本文提出一种新的关系感知方法:协作学习(RACL)框架充分利用ABSA任务中的交互关系。我们将该模型与现有方法进行了比较,其利用交互关系的能力见表1。

RACL是一个多层多任务学习框架,通过关系传播机制相互增强子任务的性能。

对于多任务学习,RACL采用共享私有方案shared private scheme(Collobert和Weston, 2008;Liu等,2017)。子任务AE、OE和SC首先联合训练底层共享特征,然后独立训练高层私有特征。 通过这种方式,共享特征和私有特征可以分别嵌入任务不变知识和面向任务的知识。

在关系传播方面,RACL通过在三个子任务之间交换信息线索来提高模型的能力。

此外,RACL可以堆叠到多层,以在不同的语义层次上进行协作学习。

下篇: |

|